记得第一次在郑州一家制造企业落地MES时,最先碰到的不是界面,而是数据流:车间数据抖动、网络中断、多版本并发写,业务看起来简单,技术却像洋葱层层剥开。那次我们把核心接口拆成幂等写、事件落盘与异步补偿三步走,才把故障率从每周十几次降到偶发。我的体会是:落地比设计更考验工具链与运维细节。

后端栈我们倾向Spring Boot 2/3做稳定服务,结合MyBatis精细化SQL控制;高并发模块用Go编写轻量RPC。数据库以MySQL主从+Proxy层读写分离为主,关键写入用行级锁与乐观锁结合,索引设计从EXPLAIN入手,避免覆盖索引反而回表。调优时,我常用pt-query-digest定位慢查询,再用索引合并或拆表治理,效果往往立竿见影。

分布式事务不是万能药。我们使用MQ+事务消息或Seata做半事务补偿,碰到必须强一致的业务则把边界推前端、拆成补偿操作。遇到并发冲突,会优先考虑业务端去重与幂等token,而不是盲目加锁;实践证明,幂等设计更易维护,也更节省资源。

容器化与CI/CD是尺度问题。项目用Docker构建镜像,Kubernetes部署,Helm管理发布版本;CI用GitLab CI,镜像扫描用Trivy做安全预检。实操里最易被忽视的是资源请求与限额:不给容器合理的CPU/内存,集群冷启动就会把你鞭策得很痛。我的习惯是先用负载测试来定基线,再迭代调整调度策略。

监控与追踪决定故障恢复速度。Prometheus+Grafana覆盖指标,OpenTelemetry+Jaeger追踪调用链,日志通过Loki集中检索。一次线上GC抖动让我对观测数据有了敬畏:单靠曲线看不够,必须把trace id贯穿到日志与性能剖面工具里,才能在十几秒内定位问题。

缓存策略需有层次感。Redis不仅作热点缓存,也承担分布式锁与速率限制。为防缓存穿透和雪崩,我们引入二级缓存与互斥锁,热点用本地LRU+TTL短过期配合后台刷新;实践表明,合理的失效策略比无脑加大内存更有效。

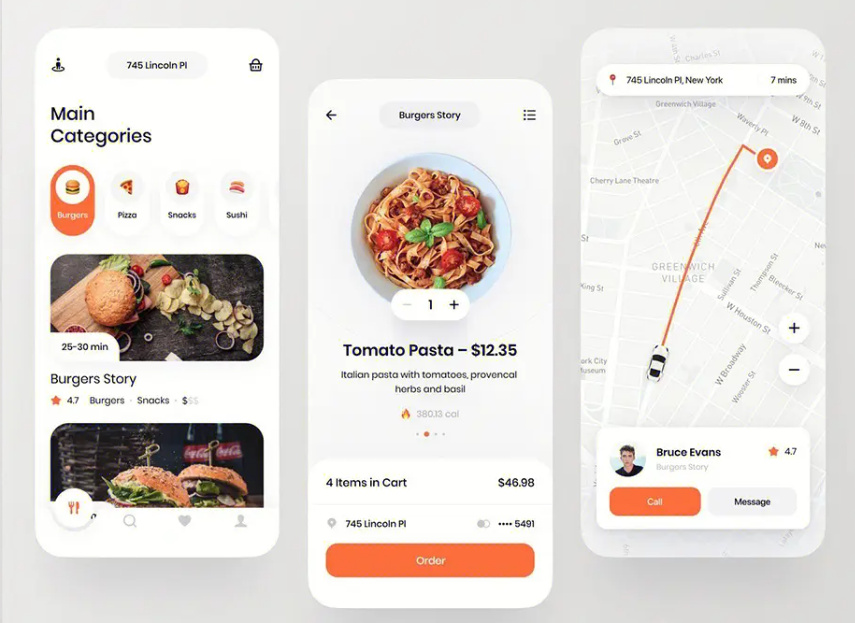

前端与移动端选型以稳定和可维护为先:Vue3+TypeScript用于管理后台,React Native或Flutter用于移动端Demo快速迭代。接口设计遵循严格的版本控制,向后兼容是我常强调的工程原则。总结一句:工具不是答案,工程化的细节与回滚路径才决定能否稳定交付。

展望未来,我会更倾向于用OpenTelemetry统一观测,边缘侧用轻量化Go服务承载高并发,核心业务继续在成熟的Java生态。最后给同行一句实操建议:把排查链路做长一点,错误留痕做足,能救你一个深夜的版本回滚时间。

咨询在线QQ客服

咨询在线QQ客服